Google hat nicht nur neue Funktionen für die Pixel-Smartphones und die Pixel Watch vorgestellt, generell hat man Neues für Android parat. Google erweitert die Funktionalität von Android mit einer Reihe neuer KI-gestützter Features. Die Neuerungen zielen darauf ab, die Interaktion mit dem Smartphone natürlicher und effizienter zu gestalten.

Eine Verbesserung betrifft die Lookout-App, die Menschen mit Sehbehinderung unterstützt. Das Gemini-1.5-Pro-Modell erstellt nun präzisere Bildbeschreibungen, die von einer natürlichen Stimme vorgelesen werden. Nutzer können zusätzliche Fragen zum Bildinhalt stellen, was das Verständnis vertieft. Diese Funktion steht zunächst auf Englisch zur Verfügung.

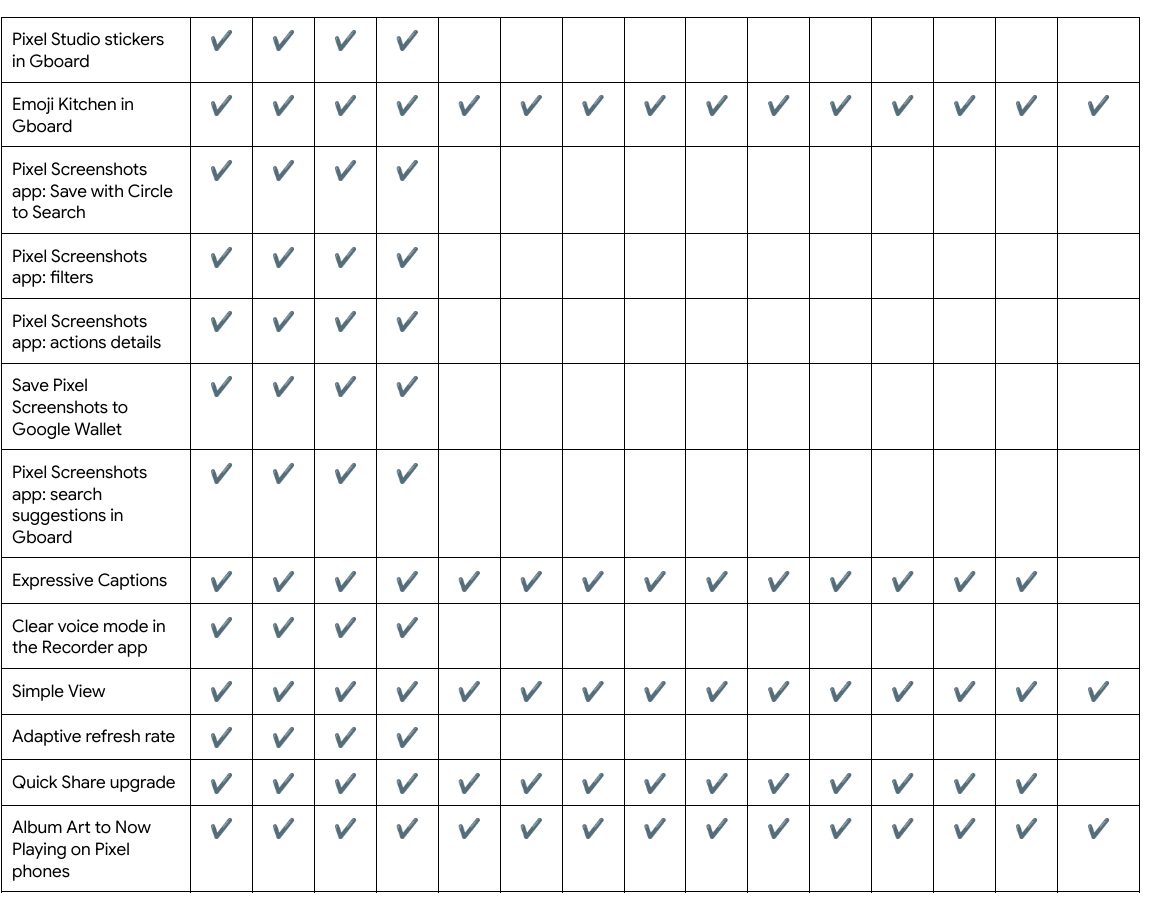

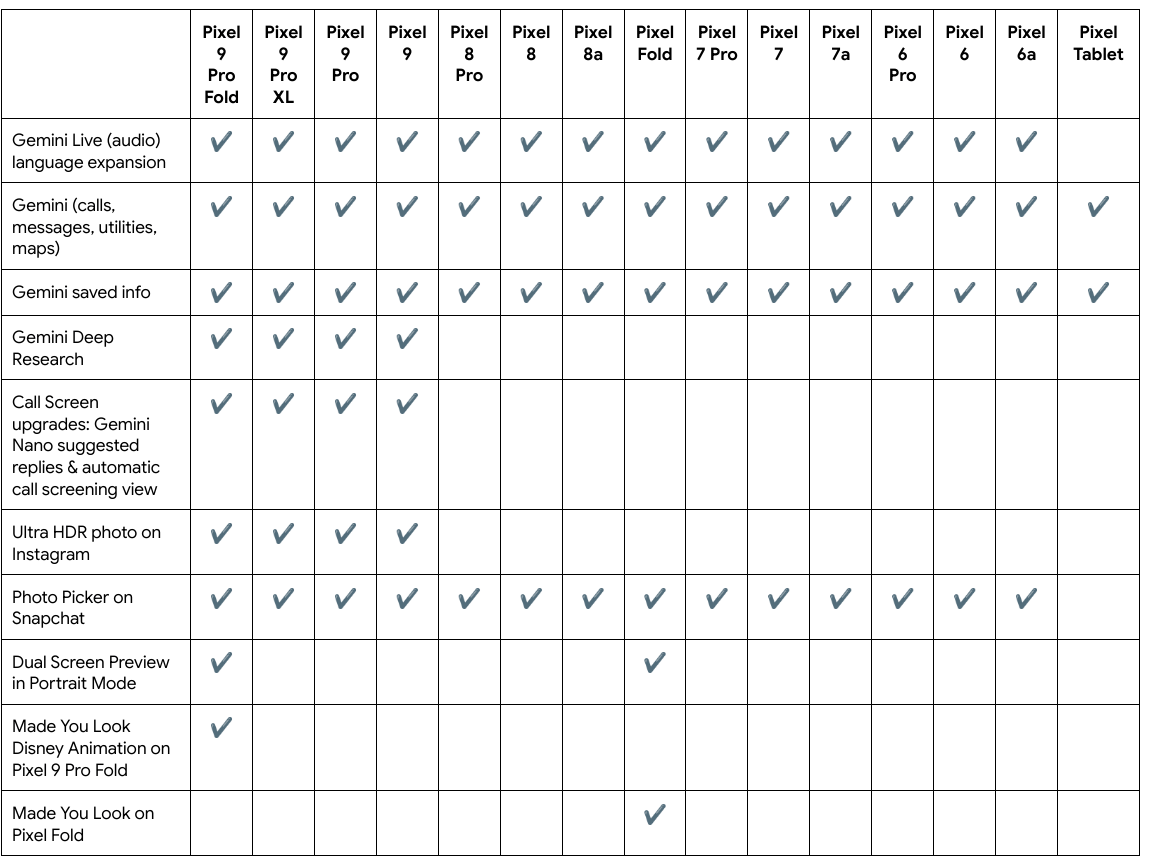

Die beliebte Emoji Kitchen in Gboard erhält neue Kombinationsmöglichkeiten. Die Integration der Clearflow-Tastatur mit Glide-Typing verspricht eine schnellere und genauere Texteingabe. Diese Verbesserung macht die tägliche Kommunikation flüssiger.

Der Datenaustausch wird durch Quick Share vereinfacht. Die neue QR-Code-Funktion ermöglicht das direkte Teilen von Medien und Dokumenten, ohne dass zusätzliche Einstellungen oder Kontaktverknüpfungen erforderlich sind.

Google Drive wurde um eine automatische Scan-Optimierung erweitert. Das System verbessert selbstständig Kontrast und Weißabgleich, während es Schatten und Unschärfen minimiert. Diese Funktion ist für alle Arten von Dokumenten und Belegen nutzbar, so Google.

Die Integration von Gemini in Android wird ausgebaut. Eine neue Spotify-Erweiterung ermöglicht die Steuerung von Musik und Podcasts. Die KI kann auch Anrufe tätigen, Nachrichten senden und Geräteeinstellungen anpassen. In Zukunft wird Gemini auch Smart-Home-Geräte steuern und erweiterte Kartenfunktionen in Google Maps bereitstellen können.

Die Entwicklung zeigt, dass Google die KI-Integration in Android systematisch ausbaut. Die neuen Funktionen sind teils durchaus sehr brauchbar.

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.