Quelle: Mistral

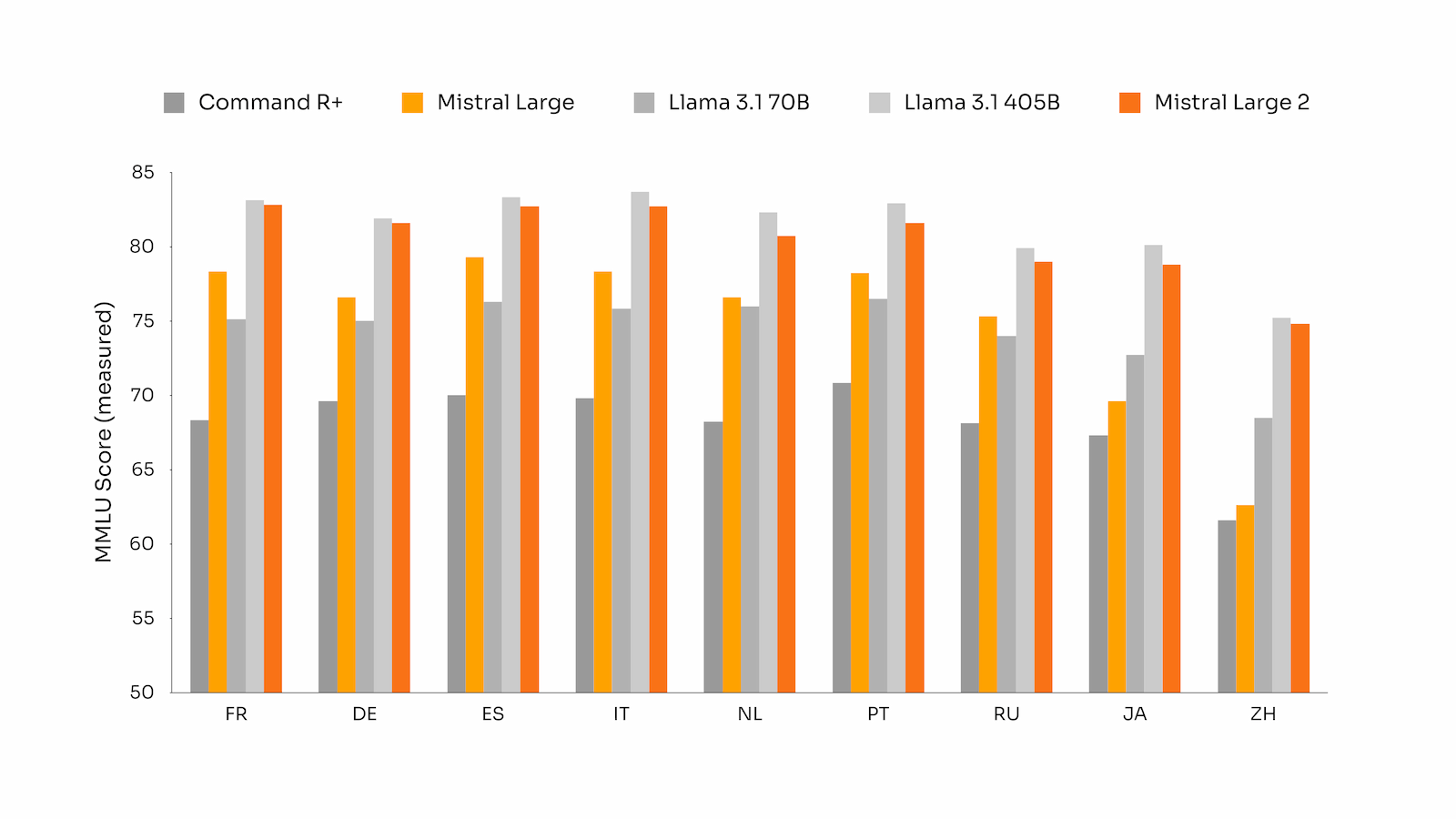

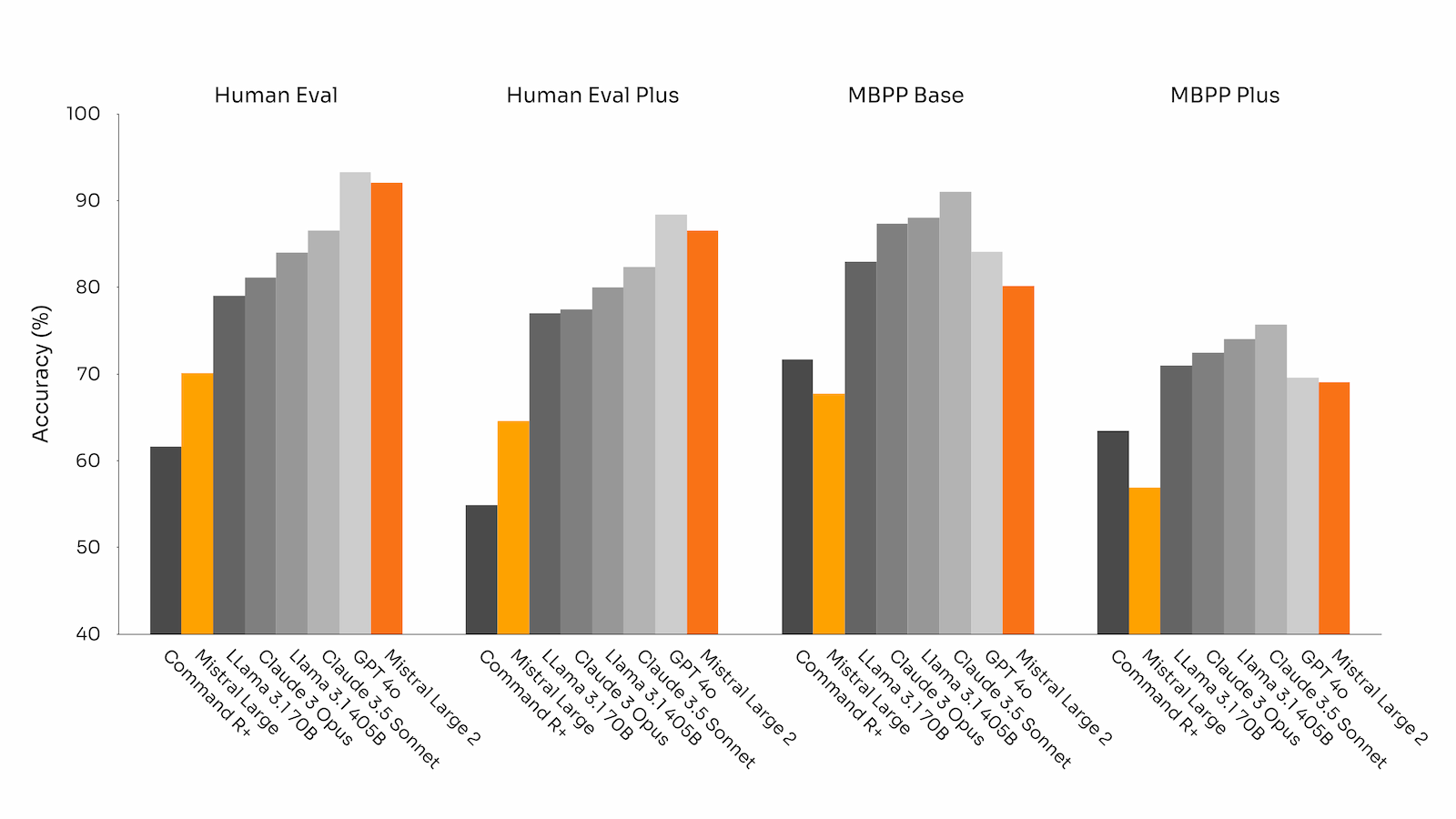

Schlag auf Schlag geht es weiter bei den LLMs und nach Llama 3.1 folgt Mistral mit seinem Modell Mistral Large 2(2407). Es hat eine Kontextgröße von 128.000 und 123 Milliarden Parameter. Es soll effizient und schnell sein, ist aber mit ca. 5 €/Million Token nicht billig. Mistral zeigt in seinem Blogbeitrag auch Benchmarks und offenbart einige interessante Aspekte, wie die Mehrsprachigkeit und die Fähigkeit, Anweisungen zu folgen. In beiden Bereichen schneidet Mistral Large 2 gut ab und kommt an GPT-4o oder Claude 3.5 Sonnet heran.

Quelle: Mistral

Besonderer Wert soll auf die Vermeidung von „Halluzinationen“ gelegt worden sein. Das Modell soll sogar darauf trainiert worden sein, vorsichtig und genau zu antworten und gegebenenfalls zuzugeben, wenn es eine Frage nicht beantworten kann.

Quelle: Mistral

Auch dieses Modell habe ich kurz getestet und muss sagen, dass es sich teilweise besser schlägt als Llama 3.1-405B. Eine Schwäche der Llama-Modelle zeigt sich hier besonders, sie sind nicht besonders gut im Folgen von Anweisungen. Dafür ist Large-2 aber auch nicht so gut im Reasoning und hat bei meinen Tests auch einfach Dinge übersetzt, die nicht übersetzt werden sollten (Funktion in TypeScript). Im Moment ist aber Claude 3.5 Sonnet mein Favorit, es ist einfach zuverlässig in der Ausgabe und vergleichsweise günstig. Was ist euer Favorit?

Transparenz: In diesem Artikel sind Partnerlinks enthalten. Durch einen Klick darauf gelangt ihr direkt zum Anbieter. Solltet ihr euch dort für einen Kauf entscheiden, erhalten wir eine kleine Provision. Für euch ändert sich am Preis nichts. Partnerlinks haben keinerlei Einfluss auf unsere Berichterstattung.